时间:2025-06-04 关注公众号 来源:网络

在科技的璀璨星空中,一场名为“流星雨”的革命悄然降临。北京理工大学的精英们,于计算机科学的殿堂内,编织着智能进化的梦幻篇章。这是一场关于代码与智慧共生的奇幻之旅,核心是SRA-MCTS——蒙特卡洛树搜索与自我驱动推理的巧妙结晶,它赋予了代码大模型以生命,使其在无人指引下踏上了自我超越的征途。

想象一个世界,模型不再是被动的工具,而是如同炼金术士般,自我锻造,自我完善。小模型摇身一变,展现出挑战大模型的惊人潜力,它们在复杂的代码迷宫中,利用SRA-MCTS的魔法,自我合成,解决着连人类专家也为之挠头的编程难题。每一次迭代,都是智慧火花的碰撞,每一行代码,都记录着进化的轨迹。

在这片知识的海洋,垂域大模型构建起自我进化的框架,它们不仅掌握着编程的奥秘,更在各专业领域中探索未知,仿佛是知识界的星际探险家。《流星雨:智启未来》带你穿越至这场技术奇点的前夕,见证人工智能从被动学习到主动创造的壮丽蜕变,探索那未知的科技边界,感受理性与灵感交织的无限可能。

北京理工大学计算机科学与技术学院的directlab启动了“流星雨”研究计划,旨在探索大模型的自我进化理论与方法。该计划的核心思想源于人类个体能力提升的模式:在掌握基本技能后,通过与环境及自身的交互,不断学习和改进。本文将重点介绍该计划在代码大模型和垂域大模型进化方面的成果。

SRA-MCTS:赋能代码大模型自我进化

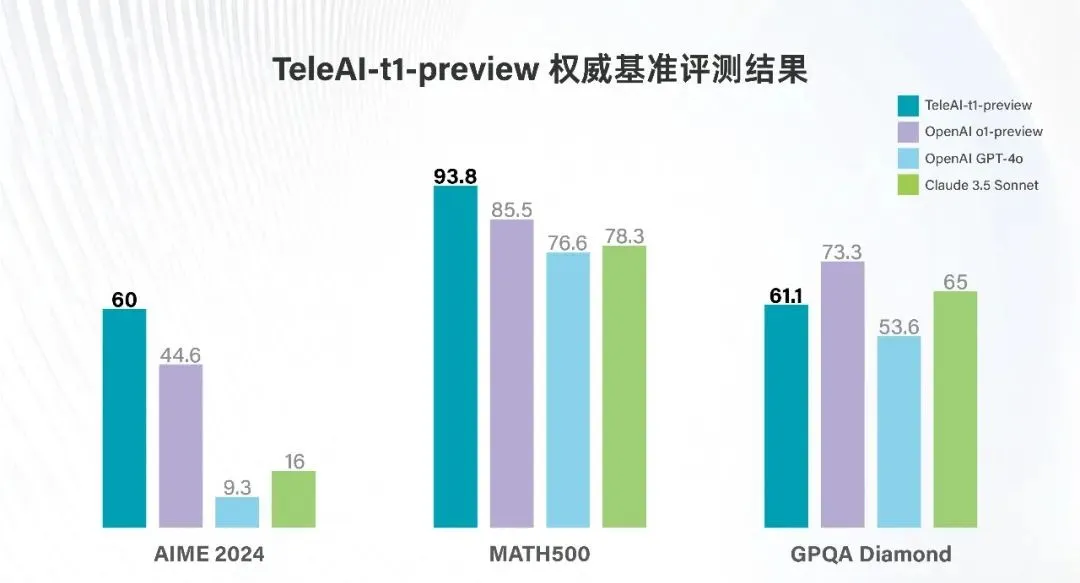

为提升代码大模型的性能,研究人员提出了SRA-MCTS方法。该方法的核心在于让模型无需外部监督信号,自主生成推理路径并转化为代码。通过自我迭代,模型能够生成更高质量的推理路径,从而提升处理复杂问题的成功率。实验结果表明,即使是小规模模型,SRA-MCTS也能显著提升其性能,尤其在处理多样化和复杂问题方面。

SRA-MCTS的主要贡献:

无监督学习:无需人工标注数据或额外监督。 持续自我提升:通过自我训练形成正反馈循环,持续改进性能。 增强复杂问题解决能力:在不同规模模型上均取得显著性能提升。 小模型自我合成潜力:小模型(2B,8B,14B)自我合成数据训练效果超越大模型数据蒸馏。SRA-MCTS的工作机制:

SRA-MCTS通过结合推理过程和数据生成,引导模型自主生成推理路径。该方法包含四个阶段:选择、扩展、评估与反思、反向传播。通过反复迭代,模型不断完善其推理能力。

示例:拓扑排序代码生成

(此处保留原文中关于拓扑排序的示例代码和解释)

流星雨计划:垂域大模型的自我进化框架

“流星雨”计划提出一个“弱到强”的进化框架,包含三个阶段:

导师监督学习:利用知识蒸馏,但采用“弱到强”的策略,让强模型根据弱模型的指导生成领域数据,从而减少认知偏差。

自我评估能力习得:借鉴StaR方法,利用更强的模型(如GPT-4)提供反馈,迭代训练模型,提升其自我纠错能力。

自我提升训练:通过对比学习(例如,beamsearchvs.greedysearch),让模型向更高效的推理策略靠拢,实现完全的自我进化。

性能分析及未来展望:

实验结果表明,应用Meteor进化方法后,LLaMA3-8B-Instruct和Qwen2-7B-Instruct在准确性、完整性等方面均有提升。未来,研究团队将继续改进各个阶段的进化方法,并拓展Meteor的应用场景。DIRECTLAB欢迎更多研究者参与合作,共同推动大模型自我进化领域的发展。(代码和数据已公开:

以上就是推动大模型自我进化,北理工推出「流星雨计划」的详细内容,更多请关注其它相关文章!

" alt="行业首批!腾讯云TI平台支持DeepSeek全系模型精调与推理">

" alt="行业首批!腾讯云TI平台支持DeepSeek全系模型精调与推理">