时间:2025-05-16 关注公众号 来源:网络

在图像处理技术的前沿探索中,浙江大学与哈佛大学两大顶尖学府携手,共同推出了革命性的图像编辑框架――ICEdit。这一创新工具标志着图像处理领域的一次重大突破,它通过引入指令式编辑理念,彻底改变了传统的图像修改方式。ICEdit不仅仅是一个软件应用,它是学术合作的结晶,旨在简化复杂的图像处理流程,让无论是专业设计师还是普通用户都能通过简单指令实现精准而高效的图像编辑。这一框架的诞生,预示着未来图像编辑将更加智能化、个性化,开启了图像创意表达的新纪元。它利用先进的算法理解用户的编辑意图,极大地提升了创作效率,降低了技术门槛,为视觉艺术和科研领域带来了前所未有的可能性。

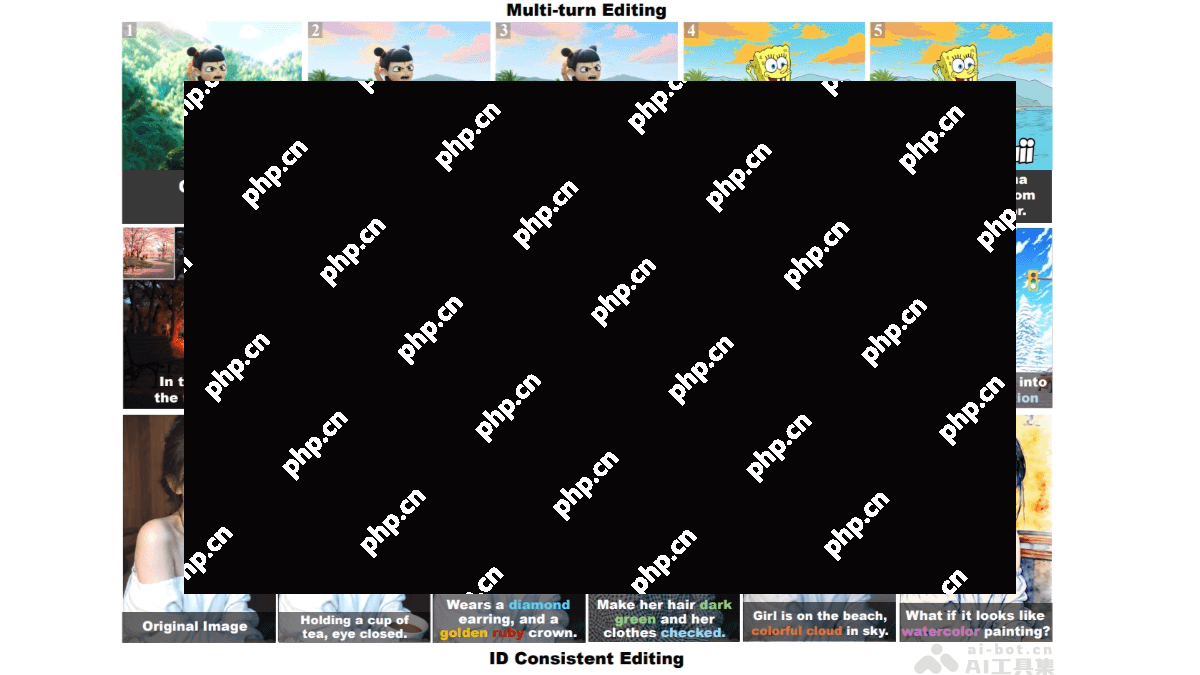

icedit(in-contextedit)是浙江大学和哈佛大学共同推出的一个基于指令的图像编辑框架。通过利用大规模扩散变换器(diffusiontransformer)的强大生成和上下文感知能力,icedit可以使用自然语言指令对图像进行精确编辑。该框架仅需0.1%的训练数据和1%的可训练参数,显著降低了资源需求,并且在多轮和多任务编辑中表现出色。icedit具有开源、低成本和快速处理(单张图像约9秒)的特点,适用于各种应用场景。

ICEdit的主要功能包括:

ICEdit的主要功能包括:

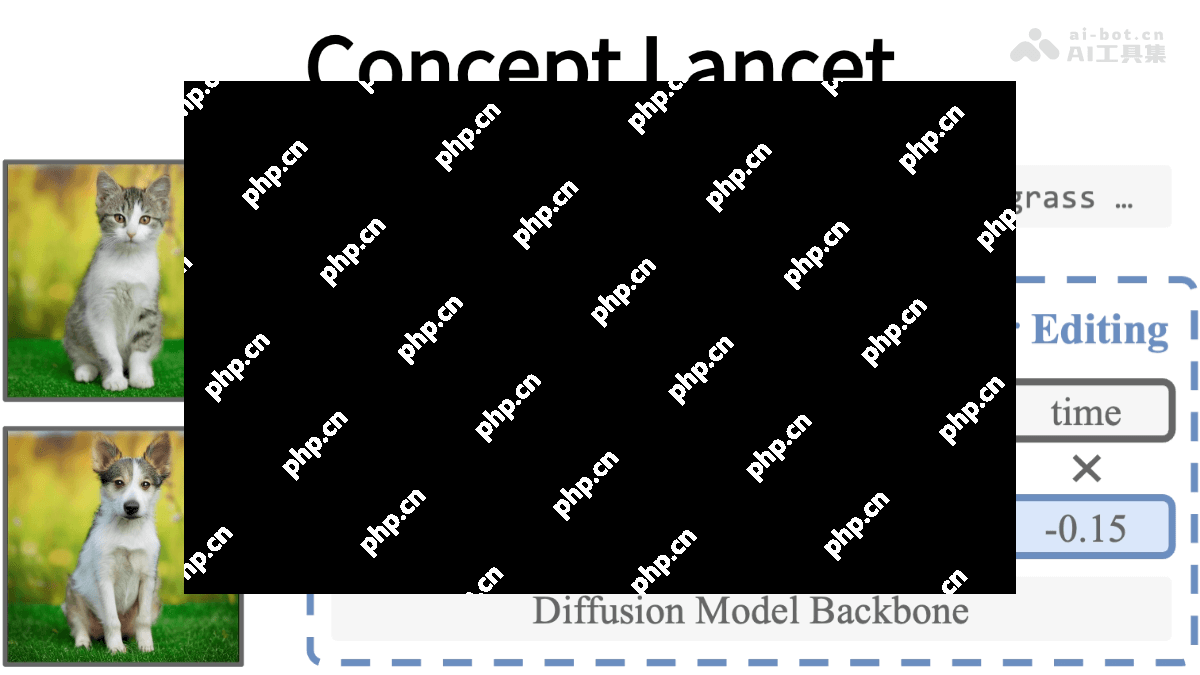

ICEdit的技术原理基于:

上下文编辑框架(In-ContextEditingFramework):通过“上下文提示”(In-ContextPrompting),将编辑指令嵌入到生成提示中,模型基于处理提示生成编辑后的图像,无需对模型架构进行修改,避免传统方法中的复杂结构调整。基于上下文理解,模型直接生成符合指令的编辑结果。 LoRA-MoE混合微调策略(LoRA-MoEHybridFine-Tuning):结合参数高效的LoRA(Low-RankAdaptation)适配器和动态专家路由(Mixture-of-Experts,MoE)。LoRA通过低秩矩阵分解,高效地调整模型参数,适应不同的编辑任务。MoE通过动态选择最适合当前任务的专家模块,进一步提升编辑质量和灵活性。仅需少量数据(50K样本)进行微调,显著提高编辑成功率。 推理时早期筛选策略(EarlyFilterInference-TIMeScaling):在推理阶段,基于视觉语言模型(VLM)评估早期生成的噪声样本,筛选出最符合编辑指令的初始噪声。用少量步骤(如4步)评估编辑效果,快速选择最优的初始噪声,进一步提高编辑质量。ICEdit的项目地址包括:

项目官网: GitHub仓库: HuggingFace模型库: arXiv技术论文: 在线体验Demo:ICEdit的应用场景涵盖:

创意设计:将照片转为艺术风格(如水彩画),或添加创意元素,用于设计和广告。 影视制作:快速生成角色设计或场景概念图,辅助影视前期开发。 社交媒体:编辑个人照片(如换背景、加特效),制作吸引人的社交内容。 教育领域:生成教学用图,如将历史人物转为漫画风格,辅助教学。 商业广告:快速制作产品宣传图,如更换背景、添加品牌标志。以上就是ICEdit―浙江大学联合哈佛大学推出的指令式图像编辑框架的详细内容,更多请关注其它相关文章!