ʱ�䣺2025-05-19 ��ע���ں� ��Դ������

�ڿƼ�����ǰ�أ�һ�������ǻ۵ľ�����Ȼչ����Ħ���̣߳���������Ź���GPU��������֣��ҿ���һ�ι����˹����ܵ���ƪ�¡����Dz�ֻ��ս���ޣ��������뿪Դ���ͷ���MT-MegatronLM��MT-TransformerEngine����������������ϴ�˵�е��ر���Ϊÿһ�����ǻ�֮����������������

����Ƭ���ֵĺ���ģ������˰㷭ӿ����Ħ���̵߳�GPU����ͬ�֮�ۣ���Ԧ��FP8��Ͼ��ȵķ籩���������ܼ������������̽����ģ̬֪ʶ��δ֪����MT-MegatronLM���������ǻ۵ĵ�ʦ������ģ�����ڻ�ϲ��е��赸�дﵽЧ�����ȶ�������ƽ�⣻��MT-TransformerEngine�����Ǽ��ٵ����棬�ھ�GPUDZ�ܣ���ÿһ��˼������ͬ�����Ѹ�ݡ�

�ⲻ������һ�������ĸ��������ǹ������������ľ��ѡ����㷨��Ӳ���Ľ������У��쳣�����������ػ��߰�ȷ��ÿһ��̽������ȫ���ü�������ƴ��֪ʶ����̽����Ҳ�ܴӷ����а�Ȼ����������һ�ι��ڴ��¡��������ǻ۵Ĺ��£�����ÿһ������ı�������㣬��ͬ��д����AI��ƪ�¡�

���գ�Ħ���߳���ʽ��Դmt-megatronlm��mt-transformerengine����ai��ܡ�ͨ������ں�fp8���ѵ���������������ӿ⣬���������ڹ���ȫ����gpu��ʵ���˸�Ч�Ļ�ϲ���ѵ��������������������ѵ��Ч�����ȶ��ԡ�Ħ���߳��ǹ�������ԭ��֧��fp8���㾫�ȵĹ���gpu��ҵ���˴ο�Դ����Ϊaiѵ���������ṩ��ȫ�µĹ�������������������ƶ�����gpu��ai��ģ�������Ӧ�þ�����Ҫ���塣

��?MT-MegatronLM��Դ��ַ��

����

��?MT-TransformerEngine��Դ��ַ��

����

��ܽ���

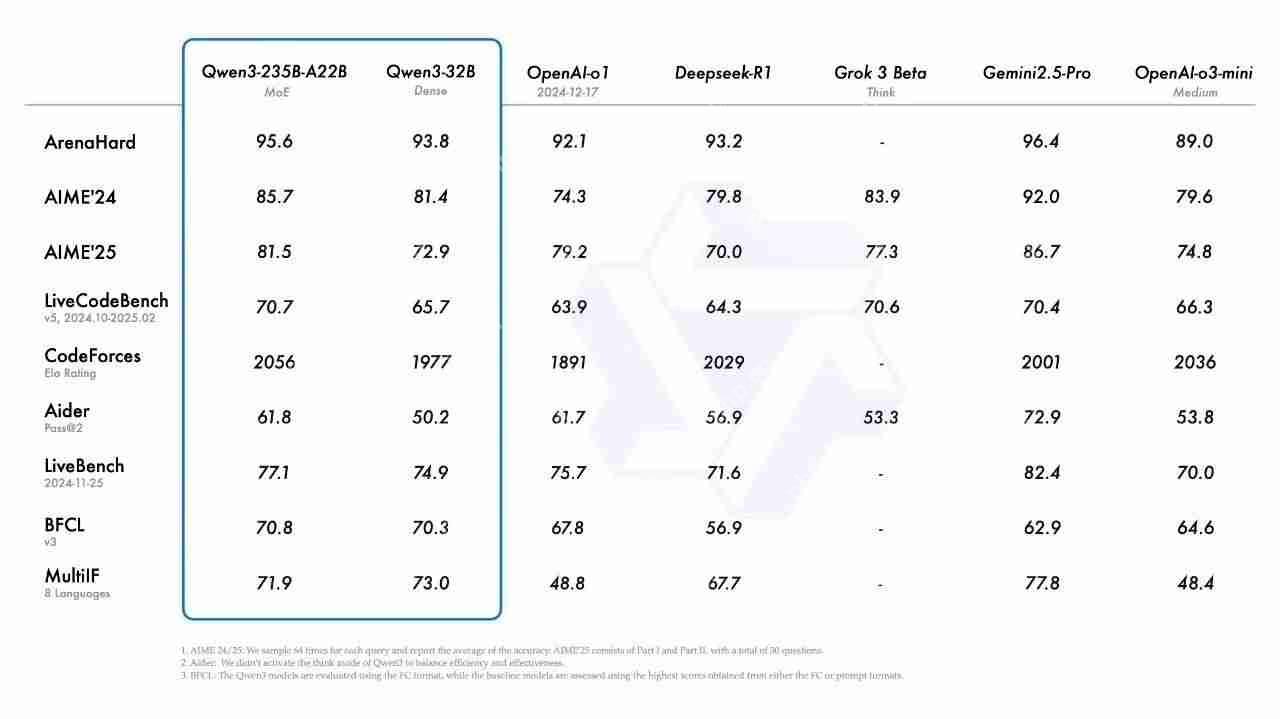

MT-MegatronLM������ȫ����GPU�Ŀ�Դ��ϲ���ѵ����ܣ�֧��denseģ�͡���ģ̬ģ�ͼ�MoE�����ר�ң�ģ�͵ĸ�Чѵ�����ÿ������ȫ����GPU֧��FP8��Ͼ��Ȳ��ԡ����������ӿ�muDNN�뼯��ͨ����MCCL������������������ȫ����GPU��Ⱥ�����������ʡ�

����MT-TransformerEngine��Ҫ����Transformerģ�͵ĸ�Чѵ���������Ż���ͨ�������ںϡ����м��ٲ��Եȼ���������ͷ�Ħ���߳�ȫ����GPU���ܶȼ����DZ����memorybound���ӵ�Ч�ʡ�

����ͻ��������

�����ܵļ���ͻ�Ƽ���������Ӳ���������㷨���µ����Эͬ��

��?��ϲ���ѵ����֧��Dense����ģ̬��MoEģ�͵Ļ�ϲ���ѵ���������Ӧ�Բ�ͬģ�ͼܹ��ĸ������㳡����

������?FP8���ѵ�����ԣ����Ħ���߳�GPUԭ��֧�ֵ�FP8��Ͼ���ѵ�����ԣ��ܹ���Ч����ѵ��Ч�ʣ�

������?���������ӿ⣺ͨ�����������ӿ�muDNN��ͨ�ſ�MCCL����ȼ��ɣ�ϵͳ���Ż��˼����ܼ���������Эͬ��ͨ�ſ�����ͬʱ���Ħ���߳̿�ԴSimumax�⣬���Զ����в��в�������������Բ�ͬģ�ͺͼ��ٻ���spec�����ѵ�����ܣ�

������?�쳣ѵ��������������õ�rewind�쳣�ָ����ƣ����Զ��ع�������ȶ��ڵ����ѵ��������������ģѵ�����ȶ��ԣ�

������?�����ļ����ԣ�������ܼ���GPU������̬���ȱ�����������̬��ƽ��Ǩ�ƣ�ҲΪ�����߹������е�AI����ջ�ṩ�˵ײ�֧�š�

��?Ħ���߳�Simumax��Դ��ַ��

����

ʵ��Ӧ��Ч��

��ʵ��Ӧ���У���������ܵij�ֽ���Ѿ�ȡ���������ijɹ�����Щ�ɹ�������֤�˿�ܵļ�������ȣ�ҲΪ����GPU��̬�Ĺ�ģ��Ӧ�õ춨�˼�ʵ������

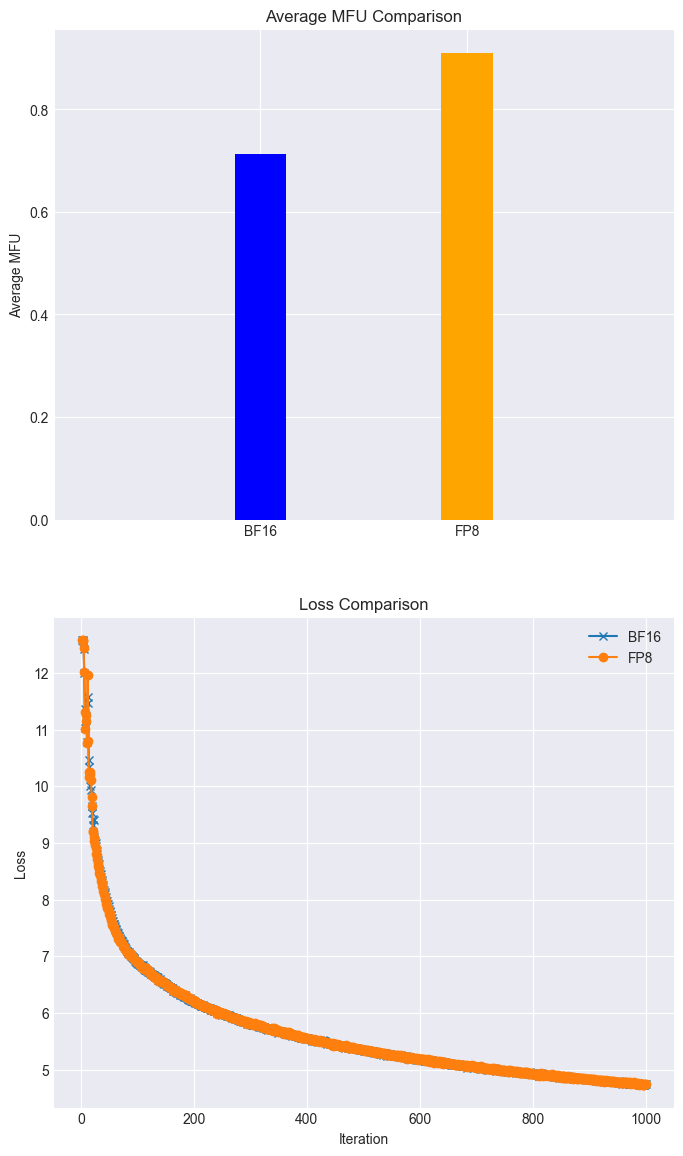

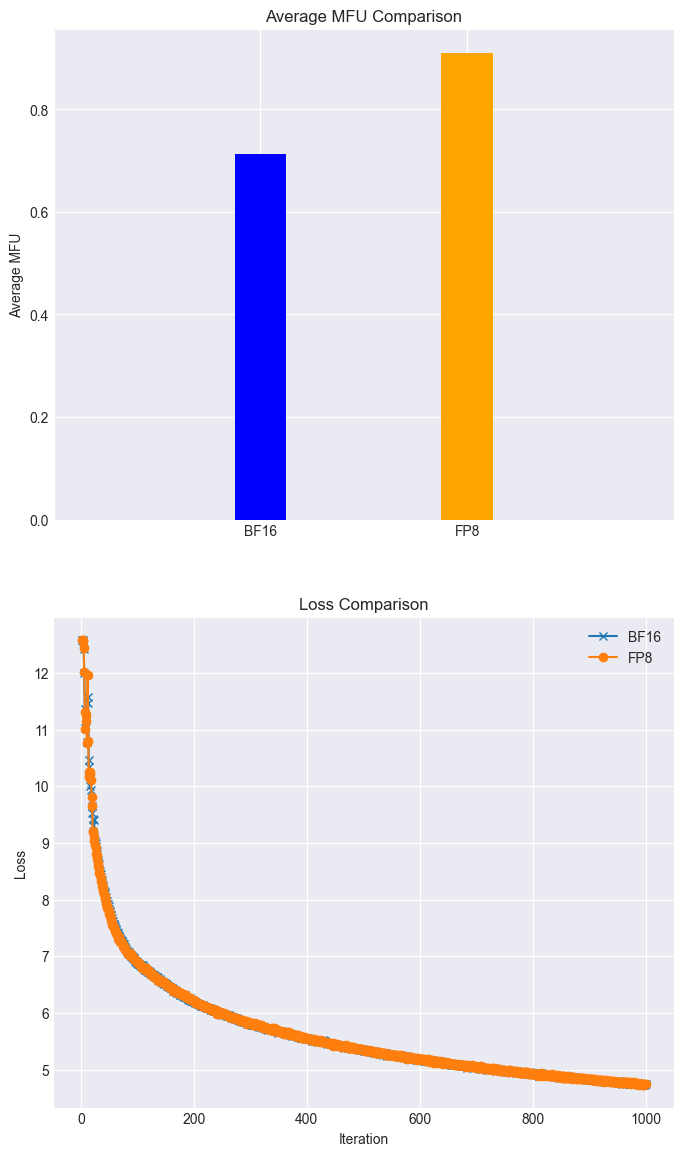

��?��Чѵ������ȫ����GPU��Ⱥ�ϣ�Llama38Bģ�͵�ѵ������������FP8��loss��������������MFU�ﵽ90%���ϣ�������ͼ��ʾ��

ͼע������Ħ���߳�FP8��Ͼ��ȼ��ټ�����loss�����������õ�28%�ļ���

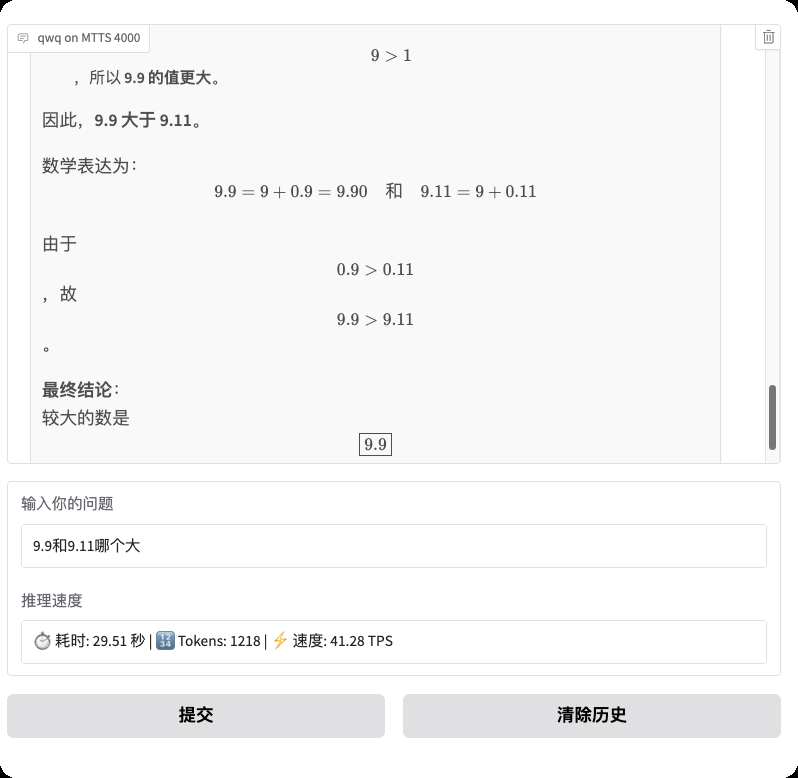

��?����DeepSeek��Ѫ��ѵ����Ħ���߳�����ȼ��ɲ���Դ��DeepSeek�����㷨DualPipe�ĸ�Ч֧�֣�MT-DualPipe������������MT-Megatron��ܺ�MT-TransformerEngine��ܣ��ɹ�ʵ��DeepSeekV3ѵ�����̵��������֣�֧��MLA��MTP������ר��ƽ����ԣ�

������?���ܴ���Ż���ͨ������Transformer�����ںϼ����������������ڴ����������ʣ���Ч����memoryboundƿ������һ���ͷŹ���GPU��Ӳ��DZ����

�����Ż�����̬����

Ϊ���ٹ���GPU��̬��չ�뽨�裬Ħ���߳̽������Ż�MT-MegatronLM��MT-TransformerEngine��ܣ�������һϵ�д��¹��ܣ�

��?DualPipe/ZeroBubble���в��ԣ���һ�����������ʣ���������ѵ��Ч�ʣ�

������?����FP8�Ż����ԣ�������FP8�Ż����ԣ����ѵ�������ܺ��ȶ��ԣ�

������?�첽checkpoint���ԣ����ѵ�������е��ݴ�������Ч�ʣ�

������?�Ż�����ؼ�����ԣ����ټ�����Դ濪�������ѵ���ٶȣ�

������?�ݴ�ѵ�����ԣ��������ݴ�ѵ���㷨����ǿѵ�������е��ݴ�������

������?����Ħ���߳�FlashMLA��DeepGemm�⣺��һ���ͷ�Ħ���߳�GPU��������FP8���������������������ܺ�Ч�ʡ�

Ħ���߳�ʼ���������ƶ���Դ��̬�ķ�չ��ͨ��������������̬���������ٹ���ȫ����GPU��AI��������Ĺ�ģ��Ӧ�ã�Ϊ�����û��ṩ�����ܡ���Ч�Ľ��������

���Ͼ��ǿ�ԴMT-MegatronLM��MT-TransformerEngine��Ħ���߳�GPUԭ��FP8��������AIѵ������ϸ���ݣ��������ע����������£�

����������Դ�����磬��������վ���������ַ�������Ȩ�棬����ϵ����ɾ��������վΪ��ӯ��������վ��

�绰��13918309914

QQ��1967830372